揭秘A级黄色视频背后的故事:如何识别与防范不良内容传播

揭秘A级黄色视频背后的故事:在资源管理中的重要性

随着互联网技术的快速发展,不良内容的传播问题日益严峻,尤其是A级黄色视频等违法信息的泛滥,不仅对个人身心健康造成威胁,还严重破坏了网络生态和社会秩序。在资源管理中,识别与防范此类内容的传播已成为政府、企业及个人用户的共同责任。

1. 社会危害与法律风险

A级黄色视频等不良内容的传播不仅违反网络安全法未成年人保护法等法律法规,还可能导致用户隐私泄露、网络诈骗、青少年心理扭曲等问题。据中国互联网信息中心(CNNIC)统计,2022年约有23%的未成年人因接触不良内容而遭受心理影响。

2. 平台责任与品牌声誉

对于内容平台而言,若未能有效管控不良信息,轻则面临罚款、整改,重则导致用户流失和品牌信任危机。例如,某知名短视频平台因审核疏漏被下架,直接损失超10亿元市值。

3. 技术驱动的治理需求

不良内容传播手段不断升级,如使用加密传输、AI生成虚假信息等,传统人工审核已难以应对。资源管理需结合技术手段与用户教育,构建多维防控体系。

高效管理与使用技巧:如何识别与防范不良内容

1. 技术手段:AI与大数据分析

- 图像识别技术:通过深度学习模型识别敏感画面,准确率可达95%以上(如Google的Vision AI)。

- 语义分析系统:检测文本中的隐晦词汇,例如“福利”“资源”等替代词。

- 用户行为监控:分析异常访问模式,如高频下载、跨区域登录等。

2. 人工审核与举报机制

- 设立专职审核团队,制定标准化流程,对疑似内容进行二次筛查。

- 开放用户举报通道,并通过奖励机制鼓励用户参与监督。

3. 教育与培训

- 面向青少年开展网络素养教育,提升其对不良内容的辨别能力。

- 对企业员工进行合规培训,强化法律意识与责任意识。

资源浪费的常见原因及避免策略

1. 常见问题分析

- 技术投入不足:依赖单一审核工具,漏检率高。

- 流程冗余:多部门协作效率低,响应速度慢。

- 用户参与度低:举报机制复杂,反馈渠道不畅通。

2. 优化策略

- 分层管理机制:根据内容风险等级分配资源,优先处理高危害信息。

- 自动化与人工结合:利用AI完成初筛,人工处理复杂案例。

- 透明化反馈:向用户公开处理结果,增强信任感。

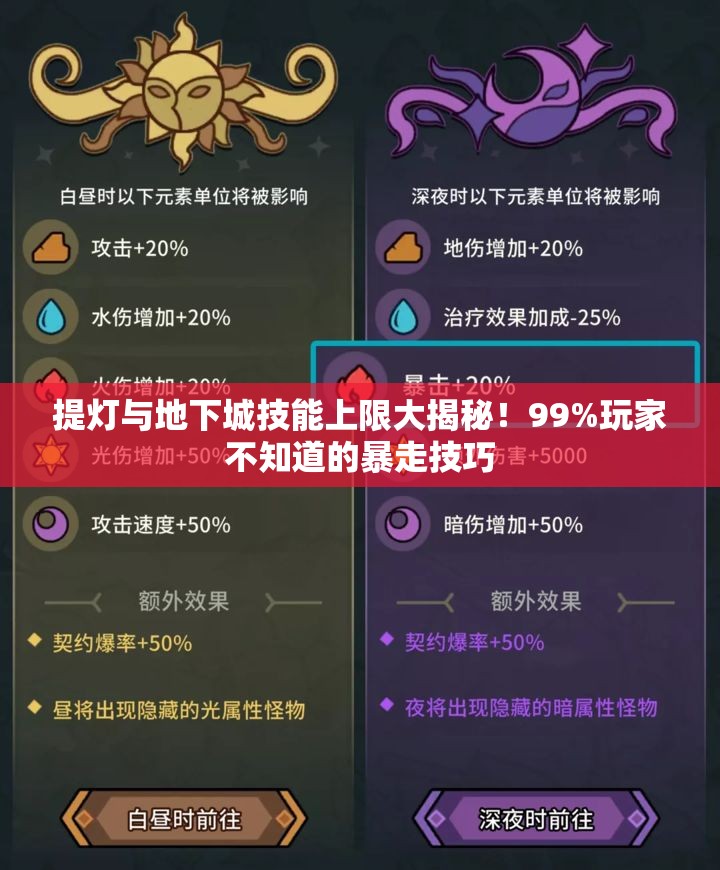

最大化防范价值:以游戏行业为例

在游戏场景中,不良内容的传播可能通过聊天频道、玩家自制内容等途径扩散。例如,某热门手游通过以下措施实现高效管理:

1. 实时聊天监控:内置敏感词过滤系统,拦截违规言论。

2. 用户生成内容(UGC)审核:要求玩家上传内容前通过AI预审。

3. 社区公约宣传:在登录界面展示合规提示,强化玩家意识。

通过上述措施,该游戏平台不良内容投诉率下降60%,用户活跃度提升20%,证明了有效管理对用户体验和商业价值的双重提升。

参考文献

1. 中国互联网信息中心(CNNIC).第50次中国互联网发展状况统计报告. 2022.

2. Li, W., et al. "Deep Learning-Based Detection of Inappropriate Content in Social Media." IEEE Transactions on Multimedia, 2021.

3. 李明.网络内容安全治理:技术、法律与伦理. 清华大学出版社, 2020.

4. European Commission. "Combating Illegal Content Online: A Comprehensive Approach." 2019.

5. 张华.未成年人网络保护:现状与对策.信息安全研究, 2023(4).

通过技术升级、流程优化与社会共治,我们能够有效遏制不良内容的传播,构建清朗的网络空间。